Helmholtz' Überlegungen zur Sinneswahrnehmung sind wieder höchst aktuell: Unter dem Begriff „Helmholtz-Maschine“ entwickeln Informatiker Algorithmen, die in Daten Muster erkennen – bis hin zu einer aktiv lernenden künstlichen Intelligenz.

Helmholtz' Überlegungen zur Sinneswahrnehmung sind wieder höchst aktuell: Unter dem Begriff „Helmholtz-Maschine“ entwickeln Informatiker Algorithmen, die in Daten Muster erkennen – bis hin zu einer aktiv lernenden künstlichen Intelligenz.

Entspricht das, was wir sehen, der Wirklichkeit? Oder lassen wir uns täuschen? Wie können wir überhaupt Dinge sehen und erkennen? Fragen, die Hermann von Helmholtz intensiv beschäftigten. Seine Überlegungen sind wieder höchst aktuell: Unter dem Begriff „Helmholtz-Maschine“ entwickeln Informatiker Algorithmen, die in Daten Muster erkennen – bis hin zu einer aktiv lernenden künstlichen Intelligenz.

Gleich zu Beginn seiner Laufbahn, als frisch gebackener Professor für Physiologie in Königsberg, entwickelte Hermann von

Helmholtz raffinierte Versuche, um die Reizleitungsgeschwindigkeit in Nervenzellen zu messen. Er erfand den Augenspiegel, mit dem er sich einen Namen macht. Gleichzeitig dachte er über eine Frage nach, die eher philosophisch erscheint: Wie kommen wir von Sinneseindrücken zu einer Wahrnehmung, einem bewussten Bild von der Welt?

„Helmholtz hat als einer der Ersten gesagt: Sehen ist kein passiver Prozess.“

Als gutem Beobachter war Hermann von Helmholtz nicht entgangen, wie leicht sich die Sinne täuschen lassen. Was wir wahrnehmen, ist nicht deckungsgleich mit der Wirklichkeit. Er kannte nicht nur optische Täuschungen, sondern auch einige Zaubertricks, da er mit Freunden gerne Zaubervorstellungen besuchte. „Helmholtz hat als einer der Ersten gesagt: Sehen ist kein passiver Prozess. Es ist nicht so, dass etwas ins Auge fällt und damit einen getreuen Abdruck im Gehirn erzeugt“, sagt Jenia Jitsev, Neuroinformatiker am Forschungszentrum Jülich. Ein gutes Beispiel dafür sind optische Täuschungen. „Selbst wenn man weiß, dass es eine optische Täuschung ist, bleibt sie bestehen. Man muss erst einen Bereich des Bildes verdecken, damit die Illusion aufhört. Man muss also einen Teil der Sinnesreize blockieren, um das Ganze als Täuschung zu erkennen“, erklärt Jenia Jitsev.

Dass der Mensch kein objektives Bild der Welt sieht, war keine neue Idee. Schon Platon erzählte im Höhlengleichnis davon. Immanuel Kant präzisierte: Um einen Gedanken zu fassen, ist es nötig, das Chaos der Sinneseindrücke zu strukturieren – durch vorhandene Vorstellungen von Raum, Zeit und Kausalität. Helmholtz, der Kant sehr genau gelesen hatte, fügte seine Beobachtungen zum Lernen hinzu. In einem Vortrag über die Tatsachen der Wahrnehmung erklärte er: „Je weniger geistig begabt Tiere sind, desto schneller lernen sie das, was sie überhaupt lernen können. Das neugeborene menschliche Kind ist im Sehen äußerst ungeschickt; es braucht mehrere Tage, ehe es lernt, nach dem Gesichtsbilde die Richtung zu beurteilen, nach der es den Kopf wenden muß, um die Brust der Mutter zu erreichen.“

Wo der Instinkt nicht greift, das sagt Hermann von Helmholtz damit, muss ein Lebewesen die Eindrücke aus der Umwelt ständig neu bewerten, um zu entscheiden, wie es sich verhalten soll. Es leitet dafür aus vorherigen Erfahrungen ab, was als Nächstes kommen könnte. Dann vergleicht es die Sinneseindrücke mit dieser Vorhersage. Dieser Abgleich geschieht unbewusst, vermutete Hermann von Helmholtz und schrieb dazu an seinen Freund Emil Du Bois-Reymond: „Ein heilloses Kapitel, weil man notwendig stark in das Psychologische hineingerät.“

„Die Annahme ist, dass jeder Organismus versucht, Überraschung zu vermeiden.“

Ein Beispiel aus dem Alltag: Das Kind ist eingeschlafen, der Vater kann nun aus dem Zimmer schleichen. Vermutlich weiß er, dass Legosteine auf dem Teppich liegen – er sieht im Halbdunkel hellere Kanten schimmern und steigt darüber. Aber das helle Stück Banane sieht er erst, nachdem er hineingetreten ist. Er hatte es nicht erwartet und daher auch nicht wahrgenommen. Dieses Modell der Wahrnehmung ist heute in der Kognitionspsychologie und in den Neurowissenschaften gut etabliert. Forscher:innen aus Physik, Informatik und Neurowissenschaften konnten es mathematisch als Optimierungsproblem formulieren und Modelle für das Lernen daraus ableiten, darunter die „Helmholtz-Maschine“. Diese Ideen führt der Neurowissenschaftler Karl Friston weiter. „Das Modell von Karl Friston baut auf den Ideen von Hermann von Helmholtz auf. Die Annahme ist, dass jeder Organismus versucht, aus Überraschungen zu lernen, um Fehler in der Wahrnehmung zu reduzieren. So kann er sein Modell der Welt und damit seine Vorhersagen kontinuierlich verbessern“, sagt der Informatiker Timo Dickscheid, der mit seinem Team am Forschungszentrum in Jülich ein Programm für die Neuroforschung entwickelt, das auf künstlicher Intelligenz (KI) beruht. „Das ist jedoch schwierig, denn der Organismus kennt immer nur einen kleinen Ausschnitt seiner Umgebung, niemals die gesamte Welt. Daher geht der Organismus vorab mit einem intrinsischen Modell der Welt los, das er dann mithilfe der Sinnesinformationen verbessert, um Überraschungen möglichst gut zu minimieren.“

Um im dunklen Kinderzimmer zu bleiben: Zunächst kommen in dem intrinsischen Modell des Vaters nur Legosteine vor. Erst durch den Tritt in die Banane erhält er eine Information, die dazu nicht passt, sodass er sein Modell verändern muss. Die überraschende Wahrnehmung der Banane hat also einen viel stärkeren Einfluss auf das Lernen als die erwarteten Legosteine – das ist für das Lernen sehr effizient.

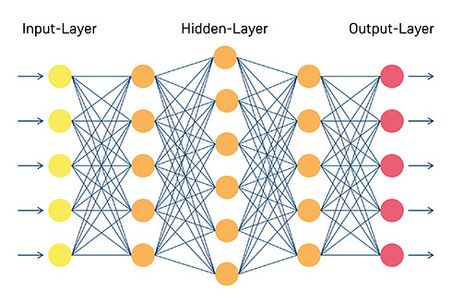

Was Hermann von Helmholtz zu seiner Zeit nicht einmal im Traum ahnen konnte: Heute lernen nicht nur Lebewesen, sondern auch Maschinen. Sie nutzen Algorithmen oder Modelle, die teilweise von der Helmholtz-Maschine inspiriert sind. „Heute gibt es noch kein generelles Modell, das in allen Fällen sehr gute Vorhersagen liefert“, sagt Fabian Theis. Der Physiker vom Helmholtz Zentrum München leitet die Initiative HAICU, in der Forscherteams zu den Themen KI und maschinelles Lernen zusammenarbeiten. „Entweder ist das Modell einfach und gut verständlich, aber dann sind oft die Vorhersagen etwas schlechter, oder man verzichtet auf gute Verständlichkeit und optimiert die Ergebnisse. Das ist das Dilemma.“

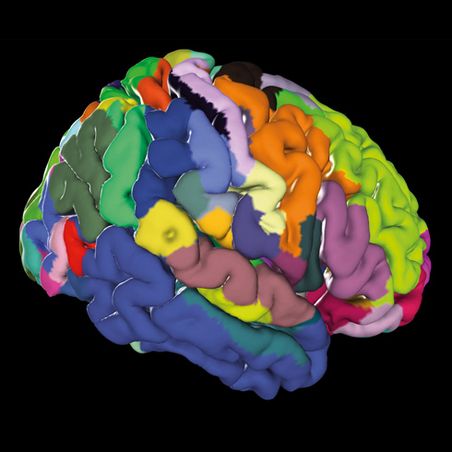

Bisher werden KI-Programme ausgiebig mit Beispielen trainiert, aus denen sie lernen. Das ist das überwachte Lernen. Programme, die medizinische Aufnahmen auswerten und interpretieren, sind bereits sehr erfolgreich. Fabian Theis hat mit seiner Arbeitsgruppe ein lernendes Programm entwickelt, das Bilder des Augenhintergrunds untersucht und darin frühe Anzeichen für krankhafte Veränderungen entdecken kann. Dies ist vor allem für Diabetespatienten hilfreich, die ein hohes Risiko haben zu erblinden. „Das Programm funktioniert gut und wir sehen auch, nach welchen Kriterien es die Risikoeinstufung vornimmt: Es fokussiert nämlich besonders auf Regionen mit Adern, wo in der Regel die Probleme auftreten“, erklärt Fabian Theis. Diese Methode des überwachten Lernens braucht allerdings Millionen Lernbeispiele, um die Aufgabe zu trainieren. Timo Dickscheid, der Jülicher Forscher, muss bei seinem Projekt anders vorgehen. „Wir haben mikroskopische Aufnahmen von Gehirnen und wollen daraus einen Atlas des menschlichen Gehirns erstellen, eine Kartierung sämtlicher Areale mit einer Auflösung auf Ebene einzelner Neuronen. Das können wir nicht mit menschlicher Leistung schaffen. Weil es aber so ungeheuer aufwendig ist, von Hand einzelne Areale zu bestimmen, können wir der KI auch nicht an Millionen Beispielen zeigen, woran sie ein Areal erkennen kann“, erklärt Timo Dickscheid.

Er setzt daher auf eine neue Strategie: das selbstüberwachte Lernen. Dabei erzeugt die künstliche Intelligenz selbst Lernbeispiele, indem sie hochaufgelöste Mikroskopieaufnahmen von Gehirnen betrachtet und analysiert. Sie kann etwa Unterschiede zwischen dem Teil der Großhirnrinde, der die visuelle Wahrnehmung ermöglicht (visueller Cortex), und demjenigen, der Bewegungen koordiniert (motorischer Cortex), erkennen. „Das System lernt zum Beispiel, dass sich Zellen im visuellen Cortex anders anordnen als im Motorcortex. Dadurch eignet es sich Erfahrungswissen an“, erläutert der Informatiker.

„Derzeit können KI-Systeme zwar ihre Ergebnisse stetig verbessern, aber sie betrachten nicht den eigenen Lernprozess.“

In Science-Fiction-Filmen oder -Romanen ist eine künstliche Intelligenz meistens ein Wesen mit eigenem Willen, das die Menschen weit hinter sich lässt. "Aber das ist im Moment nur Fiktion", sagt Jenia Jitsev: „Derzeit können KI-Systeme zwar ihre Ergebnisse stetig verbessern, aber sie betrachten nicht den eigenen Lernprozess, um darüber zu reflektieren und das Lernen selbst zu verbessern - das sogenannte learning to learn, oder Meta-Lernen.“ Erst wenn ein KI-System eigenen Lernfortschritt über mehrere Aufgaben hinweg auswerten kann und selbstständig nach fehlendem Input oder gar Aufgaben fragt, um noch besser daraus zu lernen, könnten Algorithmen auch kreative Aufgaben übernehmen, zum Beispiel lange, komplexe Texte neu verfassen.

Für einfache Sachtexte funktioniert es schon recht gut, zeigt der Textgenerator GPT3, der im Gemeinschaftsprojekt Open AI entwickelt wird. „Er errechnet, was wahrscheinlich als nächstes Wort kommt, und kann mit diesem allgemeinen Lernschema viele verschiedene Aufgaben abdecken“, sagt Jenia Jitsev. Seine Vision: „Ich glaube schon, dass wir in Zukunft Systeme haben, die uns mindestens ebenbürtig darin sind, aus der Welt schlau zu werden.“ Solche Systeme könnten dann zum Beispiel für Marsmissionen eingesetzt werden, die Menschen nicht gesund überständen. Aber vielleicht sogar für kreative Tätigkeiten oder für die politische Entscheidungsfindung. Die Menschen wären dann nur noch Konsumenten.

Das treibt auch Timo Dickscheid um: „KI findet schon heute für manche Aufgaben Lösungswege, die Menschen nicht erdacht hätten. Das ist gut, denn so können wir hoffentlich fundamentale Probleme besser bewältigen.“ Die Kehrseite sei, dass Menschen immer weniger verstünden, wie eine KI zu ihren Ergebnissen kommt. „Wie stellen wir sicher, dass wir KI-Systeme noch kontrollieren und böswillige Entwicklungen verhindern können oder starke Technologie nicht in die falschen Hände gerät?“ Diese Frage hätte sicher auch Hermann von Helmholtz beschäftigt, den philosophisch versierten Universalforscher, dessen Credo es stets war, die Wissenschaft zum Wohl der Menschheit zu nutzen.

Autorin: Antonia Rötger